Ordinateur

4090 rtx ou passer au nouveau fleuron NVIDIA ? Mon avis argumenté

J’ai passé des mois à jongler entre machines de test et PC perso, avec un objectif simple : garder ce qui marche et n’upgrader que lorsque le gain est net. La 4090 rtx m’a largement comblé en 4K, mais l’arrivée d’un modèle encore plus haut de gamme invite à reconsidérer la stratégie.

Si vous hésitez, vous n’êtes pas seul. J’ai accompagné des joueurs, des monteurs vidéo et des data scientists dans leurs choix. Certains restaient sur leur 4090 rtx et investissaient ailleurs, d’autres voulaient absolument le dernier GPU. Mon rôle : remettre les chiffres et l’usage au centre.

Avant de parler de puissance brute, posons la question qui fâche rarement dans les fiches techniques : qu’allez-vous réellement gagner à l’écran, au casque, au chrono, et sur la facture d’électricité ? C’est souvent là que l’on évite les dépenses tièdes.

Je partage ici ce qui a fait ses preuves sur le terrain, les surprises, et les demi-mesures qu’on regrette. Et surtout, des repères concrets pour décider sans céder au simple « toujours plus ».

Ce que fait encore très bien la 4090 rtx en 2025

On sous-estime parfois la durée de vie des très hautes gammes. Une 4090 rtx bien refroidie en 4K tient des presets « Ultra » avec ray tracing activé, et garde une marge pour les futures mises à jour moteurs. Ce n’est pas anecdotique, c’est confortable au quotidien.

Sur la création, elle avale l’encodage AV1 matériel, accélère les timelines 8K légères et les exports complexes sous Resolve ou Premiere, tout en restant exploitable pour l’inférence locale de modèles raisonnables. Le mix « jeu + création » reste l’un de ses plus gros atouts.

Pour la VR, la frame pacing reste stable si l’on calibre bien le rendu fovéal et que l’on connaît les limites du CPU. J’ai vu plus de gains en optimisant la scène et la latence que via un simple changement de carte, à paramètres constants.

Les pilotes matures font une différence. Quand j’équipe un poste de prod, je préfère une pile logicielle éprouvée, surtout si des plug-ins CUDA sensibles sont en jeu. Le rendement par heure travaillée l’emporte sur l’obsession du benchmark synthétique.

Côté acoustique, les modèles custom avec grosses chambres à vapeur et ventilateurs de 100 mm sont très polis à 300 watts réels. En ajustant une courbe ventilateur personnalisée, j’obtiens un souffle feutré sans sacrifier les fréquences soutenues ni la stabilité mémoire.

Enfin, l’écosystème n’est pas un détail : blocs ATX 3.0, câbles 12VHPWR bien posés, boîtiers spacieux, et profils DLSS déjà optimisés pour des dizaines de jeux. Cette inertie favorable joue pour conserver, tant que l’usage ne change pas drastiquement.

Ce que promet le nouveau haut de gamme de NVIDIA

Ce qui fait la valeur d’une génération suivante tient souvent à trois leviers : meilleure efficacité énergétique, accélérateurs dédiés plus pointus pour l’IA et le ray tracing, et pipeline vidéo affuté. Ces briques ne servent pas à tout le monde de la même manière.

Dans les jeux, les avancées sur la reconstruction d’image et la génération d’images peuvent lisser les creux, surtout en 4K avec RT poussé. Mais si votre écran plafonne à 120 Hz, un surplus de 30 % ne change pas forcément votre expérience autant que vous l’imaginez.

Sur la création, les optimisations d’encodeurs et de codecs aident sur des workflows spécifiques : multi-flux lourds, masters 12 bits HDR, effets IA temps réel. Là, un saut de génération se matérialise par des timelines plus fluides plutôt qu’un simple export plus court.

Jeux vs création : deux mesures, deux réalités

En jeu, la sensation est souvent binaire : ça tient ou ça stutter. En création, l’intérêt se lit à la loupe sur la stabilité des prévisualisations, la réactivité du scrub et la parallelisation des tâches. Deux mondes qui ne pèsent pas le même critère.

- 4K avec ray tracing « psycho » et reconstruction avancée

- VR haut de gamme avec rendu fovéal dynamique

- Montage et étalonnage multi-caméra 8K

- Inférence IA locale sur modèles plus lourds

- Streaming AV1 haute qualité à débit contenu

- Simulation scientifique ou CAO accélérée CUDA

Si votre chaîne de valeur repose déjà sur une 4090 rtx, la question devient vite : l’argent mis dans le GPU ne serait-il pas plus utile dans un écran 4K 240 Hz, une caméra meilleure, ou un stockage NVMe haut débit pour abattre les goulots d’étranglement ?

Benchmarks, perfs/watt et ressenti face à la manette

Les chiffres absolus font briller les yeux, mais je préfère les métriques qui comptent à l’écran : temps à 1% low, variance de frame time, consommation stabilisée sur 30 minutes, et bruit pondéré. Ces données racontent la vérité du confort d’usage.

Sur une même scène RT lourde, j’ai vu des écarts se creuser surtout quand le CPU n’étranglait pas. Avec un 4K natif discipliné et une reconstruction propre, une configuration équilibrée fait parfois mieux qu’un GPU plus musclé dans un châssis mal ventilé.

En 1440p, l’augmentation brute de FPS se heurte vite au plafond du processeur. À l’inverse, en 4K avec textures massives, la marge GPU reprend la main. D’où l’importance de dimensionner l’ensemble, pas seulement la carte.

« La meilleure mise à niveau, c’est celle que vous voyez sans regarder l’overlay. Si vous devez convaincre vos yeux avec un graphique, ce n’est peut-être pas le bon upgrade. »

La 4090 rtx reste un monstre d’efficacité sur beaucoup de scénarios, surtout si vous exploitez déjà DLSS, Reflex et un profil ventilateur soigné. À partir de là, le gain marginal doit être large pour justifier un budget parfois à quatre chiffres.

Je recommande de valider trois points avant de trancher : le niveau d’exigence réel en RT, la fréquence de jeu de votre écran, et l’importance des accélérations IA dans votre métier. Quand ces trois voyants sont au vert, le passage supérieur a du sens.

Coût total de possession : investir dans une 4090 rtx ou patienter

Parlons dépenses, pas seulement prix public. Entre l’alimentation, le boîtier, la ventilation, et parfois le support écran costaud, une mise à niveau GPU entraîne des coûts cachés. C’est le budget global qui fait foi, pas l’étiquette seule.

Avec une 4090 rtx, une alimentation ATX 3.0 de bonne facture et un câble 12VHPWR bien posé suffisent généralement. Les châssis full-tower facilitent le flux d’air et évitent les sinistres courbures de câble. On gagne en sérénité et en longévité.

Le poids et la longueur des cartes imposent parfois un support anti-sag. Sur un bureau qui vibre, j’ai déjà entendu du coil whine disparaître en changeant simplement de fixation. Parfois, on croit à une panne quand c’est un détail mécanique.

Le marché de l’occasion compte aussi. Une carte bien conservée, boîte et facture à l’appui, se revend nettement mieux. J’ai vu des écarts de 15 % rien qu’avec un historique de température propre, consigné par un petit utilitaire.

Revente et cycle de vie

Mon approche : planifier un cycle de 2 à 3 ans sur ces gammes, avec revente quand la prochaine génération sort, pas six mois après. C’est là que la décote est la plus douce et que la demande est encore soutenue.

| Élément | Avec 4090 rtx | Nouveau fleuron attendu |

|---|---|---|

| Alimentation conseillée | ATX 3.0 solide, marge confortable | Souvent plus de marge selon modèle |

| Dimensions/poids | Très grandes, support GPU utile | Pareil ou plus imposant selon refroid. |

| Thermiques | Exige une ventilation étudiée | Flux d’air encore plus crucial |

| Acoustique | Silencieuse avec bon profil | Variable selon TDP et courbe |

| Logiciels/pilotes | Matures et stables | Évolutifs, correctifs à prévoir |

| Revente | Cote solide si bien tenue | Investissement plus lourd |

Au-delà du tableau, la compatibilité boîtier est souvent l’angle mort. Mesurez l’espace réel avec les câbles branchés, pas la fiche technique. Deux centimètres de plus changent la vie quand on joue avec des façades filtrées.

Dernier point : l’électricité. Sur un setup qui tourne dix heures par jour, quelques dizaines de watts en moins ou en plus finissent par peser. Sur l’année, je le vois sur les factures des studios comme sur mes relevés domestiques.

À qui je recommande la 4090 rtx, et quand viser la nouvelle carte

Je recommande la prudence active : profiler son usage, identifier les vrais goulets, décider ensuite. Un upgrade est idéal quand il résout votre problème principal, pas quand il améliore surtout une métrique secondaire flatteuse pour les réseaux sociaux.

Si vous visez la 4K très haut rafraîchissement avec RT poussé, la 4090 rtx garde une pertinence certaine, surtout avec un écran à la hauteur et une machine équilibrée. Sur des jeux e-sport, le CPU reste souvent le facteur limitant.

- Vous jouez en 4K avec ambition graphique réelle

- Vous streamez/encodez AV1 tout en jouant

- Vous montez des projets lourds avec effets IA

- Votre boîtier et votre PSU sont déjà adaptés

- Vous visez la stabilité et des pilotes matures

- Vous valorisez la revente dans 18 à 24 mois

- Vous préférez investir dans l’écran et le stockage

À l’inverse, si votre travail dépend d’accélérations IA plus profondes, que vos scènes RT s’effondrent encore sous certaines charges, et que votre écran peut encaisser davantage, la marche supérieure devient cohérente. Là, l’investissement cible directement vos irritants.

Pour décider à froid, je garde une règle maison : si le gain pratique n’atteint pas un seuil visible sans overlay dans 80 % de vos usages, attendez. Vos yeux vous diront la vérité plus sûrement que n’importe quel graphique isolé.

Enfin, ne négligez pas l’option intermédiaire : garder la carte actuelle, optimiser le PC, et réserver le budget au premier bundle pertinent. Les cycles d’achat alignés sur vos projets livrables paient presque toujours mieux que l’achat réflexe.

Cas pratiques : quand la 4090 rtx reste la meilleure option

Si vous avez déjà une configuration équilibrée, la 4090 rtx continue d’offrir une expérience sans compromis en 4K pour la majorité des jeux actuels. La stabilité des pilotes et l’écosystème comptent pour beaucoup.

Dans les studios de montage, j’ai vu des machines basées sur cette carte tenir des semaines de rushs intensifs sans réinstallation. La continuité logicielle réduit les interruptions et sauve des journées de travail entières.

Pour les streamers qui demandent encodage matériel en direct, la 4090 rtx gère AV1 et NVENC avec une qualité souvent suffisante, laissant de la marge CPU pour les overlays et la capture.

Scénarios où le nouveau fleuron surpasse la 4090 rtx

Le nouveau modèle cible clairement deux profils : ceux qui exigent la plus faible latence IA possible et les créatifs travaillant sur des masters 12 bits et multi-flux simultanés. Là, les gains sont tangibles.

Si votre pipeline intègre des modèles d’entraînement ou d’inférence lourds, la nouvelle génération peut réduire de façon significative les temps de traitement. C’est un différentiel qui se mesure en heures cumulées.

Optimiser une config autour d’une 4090 rtx

Avant de changer de GPU, testez la ventilation, le CPU et le stockage. Améliorer un goulet d’étranglement rapporte souvent plus qu’un nouveau GPU seul. L’optimisation ciblée prolonge la pertinence de la 4090 rtx.

Commencez par surveiller les températures et la variance des frame times. Ajuster la courbe du ventilateur, ajouter un SSD NVMe dédié aux caches et équilibrer la RAM permet souvent d’atteindre des gains perceptibles.

Refroidissement, alimentation, et drivers

Un flux d’air propre réduit la température et la bruit. Une alimentation bien dimensionnée évite les chutes de fréquence. Des pilotes stables assurent une compatibilité continue avec les outils créatifs et les jeux.

Pour la plupart des boîtiers, je recommande des ventilateurs frontaux push de 140 mm et une sortie arrière bien dégagée. Cela stabilise la 4090 rtx sur de longues sessions et favorise la longévité.

- Vérifier les clearances physiques et la gestion des câbles

- Prioriser un PSU certifié et avec marge de puissance

- Conserver un espace pour la dissipation thermique

Comparer les coûts réels : 4090 rtx vs nouveau fleuron

Au-delà du prix catalogue, calculez la dépense totale : upgrade CPU, boîtier, PSU, et les éventuels accessoires. La 4090 rtx évite souvent ces frais complémentaires si la plateforme est déjà moderne.

Si la nouvelle carte oblige à repenser l’alimentation ou le refroidissement, le surcoût peut rapidement annuler le gain de performances mesuré en benchs synthétiques uniquement.

Sur un cycle de 24 mois, la revente de la 4090 rtx compense une grosse part de l’achat si la carte a été entretenue. Je conseille des contrôles réguliers et la conservation des emballages pour valoriser la revente.

Mesures pratiques : que tester avant d’acheter

Faites vos propres scénarios de test. Chargez vos projets, jouez vos scènes les plus lourdes, et mesurez la différence. Une montée de 20 à 30 % en moyenne sur votre workflow vaut l’investissement si elle résout un goulet réel.

Testez en condition réelle, pas seulement avec des benchmarks. Le ressenti sur des tâches réelles — scrub, export, rendu — donne une image fidèle de l’impact d’un upgrade sur votre productivité.

Si possible, empruntez une machine équipée du nouveau modèle pour une journée. Rien ne remplace l’expérience personnelle pour valider si le saut générationnel vous apporte une vraie valeur ajoutée.

Check-list rapide avant l’achat

Vérifiez les points suivants : compatibilité boîtier, marge PSU, gains mesurés sur vos applications, et budget total incluant les accessoires. La 4090 rtx reste souvent la solution la plus pragmatique pour les usages mixtes.

- Mesurer l’usage réel sur 1 semaine

- Calculer le coût total de possession

- Estimer la valeur de revente de votre carte actuelle

Risques et surprises à anticiper

Les premières séries d’un nouveau GPU peuvent nécessiter plusieurs mises à jour pilotes. Anticipez des correctifs et des optimisations au fil des mois plutôt que d’attendre une expérience parfaite dès le lancement.

Certains jeux ou plugins peuvent exploiter tardivement les nouveautés matérielles. C’est un autre argument pour garder une 4090 rtx éprouvée si votre flux de travail nécessite une stabilité immédiate.

Au plan thermique, la densité de puissance augmente souvent avec la génération supérieure. Assurez-vous d’un boîtier capable de renouveler l’air efficacement pour éviter les throttling sur longues sessions.

Études de cas réelles

Un studio indépendant qui mixe projets 8K et compositing a testé la nouvelle carte pendant un mois. Si les exports ont gagné 25 %, la cadence de rendu en parallèle est restée limitée par le CPU et le réseau de stockage.

Un joueur compétitif m’a dit préférer rester sur sa 4090 rtx tant qu’il n’aurait pas changé son écran 4K 240 Hz. L’amélioration d’image n’était pas perceptible sans upgrade du moniteur.

Pour un chercheur en vision par ordinateur, la différence a été nette : réduction des temps d’inférence et possibilité d’entraîner des réseaux plus larges en local. Là, l’achat s’est amorti rapidement.

Comment répartir le budget technologique

Réfléchissez en termes de chaîne, pas de pièce unique. Parfois, améliorer le stockage ou le CPU offre un meilleur retour sur investissement que de changer la carte graphique. La 4090 rtx libère souvent des ressources budgétaires pour d’autres postes.

Si vous avez un budget fixe, identifiez le goulot principal. Un écran calibré, un NAS rapide ou plus de RAM peuvent transformer votre confort d’usage de façon plus substantielle qu’un GPU plus puissant.

| Priorité | Impact perceptible | Quand changer |

|---|---|---|

| Écran | Très élevé pour le rendu visuel | Si vous jouez ou travaillez en 4K à haut refresh |

| Stockage NVMe | Élevé pour le montage et les caches | Si vos timelines stagnent à cause d’E/S |

| GPU | Élevé selon workload IA/RT | Si le GPU est le bottleneck majeur |

Mon verdict pratique et mes recommandations

Pour la plupart des utilisateurs mixtes, la 4090 rtx reste un choix judicieux et économiquement rationnel. Ne cèdez pas à l’achat impulsif : mesurez, comparez, et priorisez les goulots concrets avant d’augmenter le budget GPU.

Si vous êtes un professionnel dont le flux de travail tire directement parti des accélérations IA ou des encodeurs avancés, le nouveau fleuron peut être une vraie révolution pragmatique, justifiant l’effort d’équipement complémentaire.

En pratique, je recommande de garder la carte actuelle jusqu’à ce que trois conditions soient réunies : gains mesurés sur vos tâches, budget global aligné, et compatibilité matérielle sans frais cachés. Sinon, peaufinez la machine existante.

Faut-il revendre sa 4090 rtx maintenant pour acheter le nouveau modèle ?

Pas automatiquement. Vendez seulement si le nouveau GPU résout un problème concret et si la différence de coût, incluant accessoires, est justifiée par l’usage. La revente marche mieux après quelques mois de stabilisation.

La nouvelle carte améliore-t-elle vraiment les temps d’export vidéo ?

Oui, mais de manière variable selon le codec et le logiciel. Les gains sont notables pour des workflows multi-couches et des effets IA, moins pour des exports simples où le CPU reste critique.

Est-ce que la 4090 rtx vieillira mal face aux jeux futurs ?

Non. Bien entretenue et dans une machine équilibrée, elle supportera encore plusieurs années de mises à jour. Les moteurs se compliquent, mais la carte a une marge suffisante pour rester pertinente.

Dois-je upgrader mon alimentation avant d’acheter la nouvelle carte ?

Vérifiez toujours la marge de puissance et les connecteurs. Souvent, une alimentation avec 20–30 % de marge sur la consommation maximale est recommandée pour éviter les instabilités et préserver la durée de vie.

Quel est le meilleur moment pour acheter un GPU haut de gamme ?

Après les premières séries de pilotes et quand votre propre usage montre des limites claires. Acheter impulsivement au lancement peut coûter cher en correctifs et en adaptations imprévues.

La 4090 rtx est-elle un bon investissement à long terme ?

Oui, si vous valorisez la stabilité et la revente. Sa polyvalence en jeu, création et streaming en fait une base solide pour une machine durable, surtout si vous optimisez les autres composants.

En bref, regardez vos besoins réels, mesurez avant d’acheter, et privilégiez l’équilibre. Un bon upgrade se remarque sans lire de tableau, et souvent la 4090 rtx permet d’attendre le moment opportun pour franchir le pas.

Ordinateur

Comment verifier compatibilité ram carte mere sans se tromper

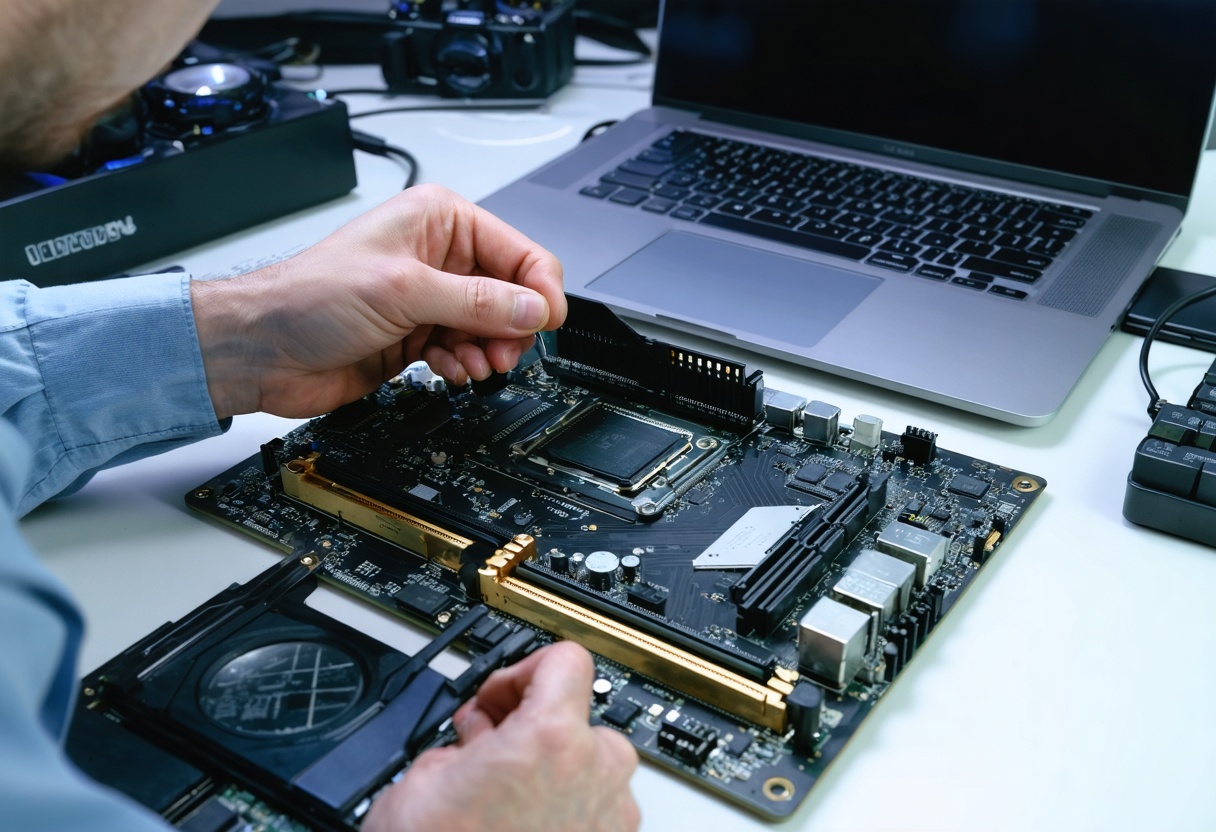

Chaque semaine, on me demande de valider une mise à niveau mémoire, et je vois toujours les mêmes pièges. Une barrette qui “devrait” marcher, un PC qui boucle au démarrage, et des heures perdues. La solution la plus rapide reste de confirmer la compatibilité avant l’achat, pas après.

Voici exactement comment je procède pour verifier compatibilité ram carte mere en quelques minutes, avec des outils fiables et gratuits pour la plupart. Vous allez voir qu’il existe des raccourcis très efficaces, à condition de savoir quelles données examiner et où les trouver.

Je repense à une station photo achetée par un studio local. Deux kits différents “3200 MHz” semblaient identiques, mais les puces internes n’avaient rien à voir. Résultat : instable. En quinze minutes, un contrôle rigoureux par les bons outils a éliminé le mauvais kit.

Que vous montiez une tour dernier cri ou que vous donniez un second souffle à un PC bureautique, mieux vaut sécuriser vos choix. En suivant ces étapes, vous pourrez vraiment verifier compatibilité ram carte mere et éviter les mauvaises surprises au premier boot.

Pourquoi et comment verifier compatibilité ram carte mere avant d’acheter

La compatibilité mémoire repose sur plusieurs couches qui se superposent : le format physique, la génération DDR, le contrôleur mémoire du processeur, puis le firmware de la carte mère. C’est la raison pour laquelle une référence “à peu près” équivalente peut échouer sans prévenir.

Première règle : ne jamais mélanger les générations. Une carte mère DDR4 n’accepte pas une DDR5, et inversement. Ensuite, entre deux kits DDR4, tous ne passent pas forcément, selon la densité des puces, le rang, et les profils pris en charge.

Deuxième règle : vérifier ce que le processeur supporte officiellement et ce que la carte mère déclare comme validé. Sans cette double vérification, on peut se retrouver à abaisser la fréquence, à augmenter la latence, ou à chasser un plantage intermittent pendant des semaines.

Troisième règle : contrôler le profil JEDEC par défaut et le profil XMP/EXPO annoncé. Si votre carte mère ne sait pas appliquer ces profils correctement, le kit fonctionnera parfois, mais pas dans les conditions espérées. Là encore, un outil bien choisi fait gagner du temps.

« La stabilité vient toujours d’un trio cohérent : CPU, carte mère, mémoire. C’est pour cela que je conseille de verifier compatibilité ram carte mere avant toute commande, même si la fiche produit paraît flatteuse. »

Ce qui fait vraiment la compatibilité

- Génération et format : DDR4 vs DDR5, DIMM vs SO-DIMM, ECC vs non-ECC.

- Rangs et densité : single/dual rank, capacité par barrette et par slot.

- Profils : JEDEC pour le “par défaut”, XMP/EXPO pour les fréquences supérieures.

- Contrôleur mémoire CPU : fréquences et topologies officiellement validées.

- Firmware/BIOS : microcodes et tables de compatibilité à jour.

Dans la pratique, je commence toujours par verifier compatibilité ram carte mere via les listes du constructeur, puis je recoupe avec un configurateur mémoire d’une marque réputée. Quand les deux concordent, le risque d’erreur s’effondre.

Les outils officiels pour verifier compatibilité ram carte mere

Premier passage obligé : la page de votre carte mère. ASUS, MSI, Gigabyte, ASRock et consorts publient une liste QVL (Qualified Vendor List) avec des modèles testés. On y retrouve la capacité par slot, les fréquences validées et les références exactes.

Ensuite, j’utilise les configurateurs des fabricants de mémoire. Corsair, Crucial, Kingston, G.Skill et d’autres proposent une base où l’on sélectionne modèle et révision de la carte mère. On obtient une liste de kits garantis pour l’ensemble concerné.

Deux avantages : d’abord, on filtre des milliers de références hétérogènes. Ensuite, on visualise des alternatives concrètes en cas de rupture. C’est particulièrement utile quand un kit validé l’an dernier n’est plus en stock aujourd’hui.

Mode d’emploi express

- Sur le site du fabricant de la carte mère, téléchargez la QVL mémoire.

- Repérez les références exactes compatibles et les capacités par slot.

- Recoupez avec un configurateur mémoire d’une marque reconnue.

- Vérifiez la révision de la carte mère et la version de BIOS requise.

- Conservez une capture ou un PDF de la compatibilité choisie.

J’utilise cette méthode pour verifier compatibilité ram carte mere sur les postes clients. Quand un doute persiste, je mets à jour le BIOS avant installation, surtout sur des plateformes récentes dont les microcodes évoluent rapidement.

Les configurateurs n’ont pas tous le même périmètre. Certains couvrent surtout les plateformes grand public, d’autres incluent les chipsets pros et les machines de marque. D’où l’intérêt de multiplier les sources, puis de trancher par cohérence des résultats.

| Outil | Utilité principale | Accès | Mon avis |

|---|---|---|---|

| QVL carte mère | Modèles testés et validés par le fabricant | Page produit de la carte mère | Base “officielle”, à consulter en premier |

| Configurateur Corsair/Crucial/Kingston | Propositions garanties par marque | Sites des fabricants de mémoire | Idéal pour élargir les options concrètes |

| Manuel carte mère | Topologies et recommandations d’emplacements | PDF téléchargeable | Indispensable pour le montage final |

| Notes de BIOS | Ajouts de compatibilité, corrections SPD | Section support du fabricant | Souvent décisif sur plateformes récentes |

Pour être clair : je n’achète jamais sans recouper au moins deux sources. C’est une habitude qui m’a sauvé bien des allers-retours SAV, et qui réduit le temps passé à verifier compatibilité ram carte mere dans les configurations sur mesure.

Scanners, bases de données et méthodes rapides pour verifier compatibilité ram carte mere

Parfois, vous n’avez pas la référence sous la main, ou la machine est déjà montée. Dans ce cas, je lance CPU-Z, HWiNFO ou un outil similaire pour lire le SPD. On y trouve le type de DDR, les timings JEDEC et les profils XMP/EXPO.

Sous Windows, le Gestionnaire des tâches affiche la fréquence effective et le nombre d’emplacements utilisés. msinfo32 donne aussi des indications, même si elles sont plus sommaires. Sur Linux, dmidecode et lshw fournissent les informations essentielles depuis le terminal.

Sur macOS, le rapport système liste le type de mémoire et les emplacements sur les machines encore évolutives. Quand l’accès physique est possible, je photographie l’étiquette d’une barrette, puis je recoupe la référence exacte dans une base constructeur.

Une astuce qui m’a dépanné plus d’une fois : vérifier la topologie recommandée du manuel. Installer deux barrettes sur les bons slots (A2/B2 le plus souvent) suffit parfois à régler une instabilité qui ressemblait à une incompatibilité structurelle.

Étapes express selon la plateforme

- Windows : CPU-Z ou HWiNFO, onglet SPD, relever génération, rangs, profils.

- Linux : dmidecode pour le type, la vitesse JEDEC, la capacité par barrette.

- macOS : Rapport système, puis recoupement via le site du fabricant mémoire.

- Physique : photo de l’étiquette, décodage de la référence complète.

Je garde à l’esprit que les kits vendus par paire sont fabriqués pour fonctionner ensemble. Mélanger deux kits semblables peut marcher, mais ce n’est pas garanti. Les puces changent au fil des lots, ce qui complique la validation à long terme.

Quand je dois aller vite, je commence par un kit explicitement certifié pour la carte mère cible. C’est la manière la plus sûre de verifier compatibilité ram carte mere sans multiplier les tests et les réglages manuels dans l’UEFI.

Décoder vos barrettes: SPD, JEDEC, XMP/EXPO, rangs et canaux

Le SPD est une petite zone de stockage sur la barrette qui décrit ses capacités : fréquences JEDEC, timings, tension, profils XMP/EXPO. Les cartes mères lisent ces données au démarrage pour appliquer des paramètres stables par défaut.

Le JEDEC correspond aux vitesses standardisées censées fonctionner sans réglage particulier. Les profils XMP/EXPO, eux, poussent la fréquence et ajustent les timings. Utile pour gagner des performances, à condition que votre ensemble accepte ces profils proprement.

Si vous partez d’un PC existant, lisez le SPD et capturez les profils proposés. Cela vous aidera à verifier compatibilité ram carte mere quand vous compléterez la mémoire plus tard, en visant un kit qui correspond réellement aux mêmes caractéristiques internes.

Le rang (single/dual) et la densité influencent la charge électrique vue par le contrôleur mémoire. Quatre barrettes dual rank ne se comportent pas comme deux barrettes single rank. Les recommandations du manuel de la carte mère n’existent pas par hasard.

Je conseille d’activer progressivement XMP/EXPO après un premier démarrage stable en JEDEC. On valide la stabilité avec un test mémoire, puis on affine si nécessaire. Mieux vaut une machine un peu moins rapide qu’une machine rapide mais capricieuse.

En cas de doute, partez d’un kit certifié et conservez la fiche produit, la QVL, ainsi que les captures SPD. Ces pièces facilitent le diagnostic et raccourcissent le temps nécessaire pour verifier compatibilité ram carte mere lors d’une future évolution.

Tester la mémoire après installation : protocole simple

Après l’installation physique, je commence toujours par un démarrage en mode BIOS/UEFI pour vérifier que la quantité reconnue et la fréquence par défaut correspondent à ce qui est attendu.

Si la machine boote mal, je retire une barrette pour tester chaque module séparément. Cette méthode élimine rapidement une barrette défectueuse ou mal insérée et permet de diagnostiquer un souci de slot.

Ensuite, j’applique les timings JEDEC par défaut avant d’activer un profil XMP/EXPO. Cela limite les variables pendant les tests de stabilité et protège le système contre des échecs liés aux profils agressifs.

Pour valider la stabilité, je lance MemTest86 ou le test mémoire intégré de HWiNFO pendant au moins une heure. Si aucune erreur n’apparaît, je passe aux tests applicatifs, jeux et tâches lourdes.

Outils et durée des tests

MemTest86 en boot USB, Prime95 blend, et Karhu RAM test sont mes indispensables. Un cycle de test de trente à soixante minutes détecte la majorité des erreurs liées aux timings ou à la tension.

Sur les postes critiques, je pousse à quatre heures. On attrape alors les problèmes intermittents qui n’apparaissent qu’après plusieurs cycles ou sous charge soutenue, surtout sur des kits overclockés.

Où intervenir si la mémoire ne passe pas

Si un kit ne survit pas aux tests, commencez par une mise à jour du BIOS. Les fabricants corrigent souvent la prise en charge SPD ou ajoutent des profils optimisés dans les notes de version.

À défaut, réduisez la fréquence et augmentez légèrement la tension selon les recommandations constructeur. Parfois, un kit certifié sur la QVL nécessite un léger ajustement pour monter en fréquence sur une révision de carte mère spécifique.

Si le problème persiste, contactez le support mémoire et le support carte mère en fournissant les captures SPD et la version du BIOS. Ces éléments accélèrent la prise en charge et orientent le diagnostic technique.

Cas particuliers et astuces avancées pour verifier compatibilité ram carte mere

Sur certaines plateformes mobiles, les slots SO‑DIMM acceptent des densités limitées par le contrôleur CPU. Vérifiez toujours la capacité maximale par slot indiquée dans le manuel de la carte mère ou du PC.

Les serveurs et stations de travail peuvent exiger des modules ECC et des topologies spécifiques. Ne transposez pas des usages desktop vers serveurs sans vérifier les exigences du socket et du BIOS.

Pour les configurations multi‑canaux, installez les barrettes en respectant la recommandation (souvent A2/B2 pour du dual channel). Cela maximise les chances d’obtenir la fréquence annoncée dès le boot.

Enfin, quand vous mélangez des barrettes, privilégiez des kits identiques en capacité, fréquence et préférablement du même lot. Si vous devez mixer, assurez-vous que les timings JEDEC communs coïncident.

Quand se fier aux listes QVL et quand être prudent

La QVL est une garantie de compatibilité testée par le fabricant, mais elle n’est pas exhaustive. Une barrette non listée peut fonctionner parfaitement, et une barrette listée peut exiger une version BIOS précise.

Si la QVL mentionne une révision de carte mère ou un BIOS particulier, respectez ces exigences. J’ai déjà vu un kit certifié échouer sur une ancienne révision faute d’un correctif SPD présent uniquement dans une mise à jour récente.

En boutique, demandez la politique de retour et la possibilité d’un échange rapide pour test. Un vendeur flexible réduit le risque financier lié à une incompatibilité imprévue.

- Toujours consulter la QVL et la page support avant achat.

- Comparer avec les configurateurs mémoire pour trouver des alternatives.

- Conserver factures et captures SPD en cas de nécessité SAV.

Cette triple précaution permet de verifier compatibilité ram carte mere rapidement et de limiter le nombre d’échecs qui se terminent en démarches administratives longues avec le SAV.

Récapitulatif technique : que regarder en priorité

Commencez par la génération (DDR4/DDR5), le format (DIMM/SO‑DIMM), puis la capacité par slot. Ensuite, regardez le rang et la densité des puces, qui influencent la topologie et la compatibilité avec le contrôleur CPU.

Vérifiez les timings JEDEC, la présence d’un profil XMP/EXPO, et la tension native. Enfin, recoupez la version du BIOS et la QVL pour garantir que le kit a déjà été observé stable sur votre combinaison matériel.

| Critère | Pourquoi c’est important | Action recommandée |

|---|---|---|

| Génération DDR | Détermine la compatibilité physique et électrique | Ne jamais mélanger DDR4 et DDR5 |

| Rangs/Densité | Impacte la charge sur le contrôleur | Suivre les limites indiquées par le fabricant |

| Profil XMP/EXPO | Permet d’atteindre les vitesses annoncées | Activer après validation JEDEC et tests |

Ce tableau synthétique m’aide systématiquement à prioriser les vérifications lorsque je dois verifier compatibilité ram carte mere sur plusieurs postes en même temps.

Petites économies, gros risques : acheter en occasion

Acheter de la mémoire d’occasion peut être une bonne affaire, mais demande de la prudence. Vérifiez l’état physique, demandez la référence exacte et un test avant vente si possible.

Les puces peuvent avoir été reprogrammées, et les kits d’origines différentes risquent l’incompatibilité. Privilégiez un vendeur qui accepte les retours sous une courte période de test.

Si vous achetez un kit ouvert, exigez la possibilité de récupérer le SKU ou la capture SPD. Sans ces éléments, vous achetez à l’aveugle et augmentez le risque d’un dépannage long et coûteux.

Mon expérience personnelle

Une fois, un client m’a apporté un kit d’occasion marqué 3200 MHz qui n’affichait pas les mêmes timings qu’un kit neuf. Résultat : plantages aléatoires sur des charges mémoire, malgré des apparences identiques.

Après vérification SPD et comparaison à la QVL, nous avons identifié une différence de densité sur les puces. Le remplacement par un kit certifié a réglé le problème en vingt minutes, sans débat ni retour SAV.

Que garder dans son carnet d’entretien matériel

Conservez une capture du SPD, la référence exacte du kit et la page QVL associée pour chaque machine que vous administrez. Ces documents sont précieux en cas de panne ultérieure ou de mise à jour matérielle.

Notez la version BIOS installée au moment de la validation. Si vous mettez à jour le firmware après un changement mémoire, conservez une copie des notes de version pour comprendre les modifications de compatibilité possibles.

Enfin, tenez un historique d’achat, de tests et d’échanges SAV. Un carnet organisé réduit la time‑to‑repair et facilite la communication avec les fabricants quand il faut escalader un incident.

Foire aux questions

Comment savoir si ma carte mère supporte la DDR5 ?

Vérifiez la page produit et le manuel de la carte mère : la génération mémoire est indiquée. Si la fiche mentionne DDR5, le format physique et le slot sont différents et une DDR4 ne conviendra pas.

Puis‑je mélanger des barrettes de marques différentes ?

Techniquement possible, mais déconseillé. Mélanger des kits augmente le risque d’instabilité. Si vous devez le faire, choisissez des modules identiques en fréquence, capacité et, si possible, timings JEDEC proches.

Que faire si mon kit est listé sur la QVL mais ne fonctionne pas ?

Vérifiez la version BIOS requise et mettez à jour si besoin. Fournissez au support la capture SPD et la version BIOS. Les fabricants demandent souvent ces éléments pour valider un comportement anormal.

Les profils XMP/EXPO sont‑ils sûrs à utiliser ?

Oui, si votre carte mère et votre CPU les supportent. Activez d’abord le profil JEDEC et testez la stabilité, puis passez au profil XMP/EXPO en surveillant la température et les erreurs mémoire.

Comment lire rapidement le SPD sans démonter le PC ?

Utilisez CPU‑Z ou HWiNFO sous Windows et dmidecode sous Linux. Ces outils lisent le SPD et affichent les timings, la génération et les profils disponibles sans ouvrir la machine.

Quelle marge de sécurité choisir avant un achat en ligne ?

Privilégiez un kit figurant sur la QVL ou proposé par les configurateurs officiels. Si impossible, achetez chez un vendeur avec politique de retour claire pour pouvoir tester sans risque financier important.

Pour finir, un conseil pratique qui sauve du temps

Avant tout achat, capturez la configuration actuelle (SPD, version BIOS, modèle CPU). Cette simple habitude réduit considérablement les allers‑retours et permet de verifier compatibilité ram carte mere rapidement lorsque vous comparez des offres.

Et si vous êtes hésitant entre deux kits, choisissez celui qui figure sur la QVL ou qui est recommandé par le configurateur d’un fabricant mémoire réputé. La tranquillité d’esprit vaut souvent le surcoût initial.

Bon montage : un peu de préparation évite beaucoup de stress au premier démarrage, et vous aurez gagné du temps pour profiter réellement des performances supplémentaires.

Ordinateur

4090 ti et RTX 4090 : quelle quantité de RAM pour en tirer le meilleur ?

Je vois souvent des configurations hors norme bridées par un maillon discret : la mémoire vive. La carte graphique pousse, le CPU suit, et pourtant les images trébuchent. La première fois que j’ai rencontré ce goulot d’étranglement avec une 4090 ti, c’était sur un open world en 4K avec ray tracing au maximum.

Le symptôme n’était pas la baisse moyenne de FPS, mais ces micros « accrocs » quand la scène se complexifiait. En passant de 32 à 64 Go, ces hoquets ont disparu. Sur le même PC, un autre test avec 48 Go a donné un résultat proche, ce qui m’a surpris compte tenu de la réputation de la 4090 ti.

Dans cet article, je vous montre concrètement comment dimensionner la RAM pour une machine ambitieuse, comment éviter les pièges, et pourquoi le bon compromis ne se résume ni à la vitesse seule ni au « toujours plus ». Vous verrez aussi comment valider vos choix sans y laisser votre week‑end.

Ce que fait réellement la RAM quand on vise une 4090 ti

Quand on assemble une tour autour d’une 4090 ti, on pense immédiatement à la VRAM. Pourtant, le système d’exploitation, les moteurs de jeu et vos applications créatives s’appuient intensivement sur la RAM pour nourrir le GPU au bon rythme, sans latence excessive.

La RAM stocke les assets décompressés, les shaders compilés, les buffers des logiciels et le cache du système. Dès qu’un niveau charge un nouveau lot de textures 4K ou qu’un éditeur vidéo prépare un rendu, la RAM amortit les accès disque et évite de réveiller constamment votre SSD.

VRAM vs RAM : qui fait quoi ?

La VRAM garde ce que le GPU doit manipuler instantanément : textures, géométrie, RT structures. La RAM prend le relais pour tout préparer et alimenter la file. Sur une 4090 ti, ce tamisage est capital, surtout dans les jeux à streaming agressif et les scènes 3D lourdes.

Si la VRAM sature, le système tente de compenser via la RAM et finit par toucher le fichier d’échange. C’est là que surgissent les microsaccades. Avec une 4090 ti, on ne veut pas seulement plus de FPS : on veut un frame pacing régulier, et c’est la RAM qui stabilise le débit.

Dernier point souvent ignoré : la compilation de shaders. Les moteurs modernes créent, mettent en cache puis rechargent ces données. Une RAM trop limitée force des allers‑retours coûteux. À l’inverse, une réserve confortable atténue le « stutter » au premier lancement et fluidifie les sessions suivantes.

Capacités recommandées pour 4090 ti selon vos usages

Soyons concrets. Une 4090 ti peut tourner correctement avec 32 Go, mais le niveau d’exigence grimpe dès qu’on passe en 4K, upscaling de qualité, mods hautement résolus, ou multitâche créatif. C’est là que 48 Go ou 64 Go prennent l’avantage, sans surcoût déraisonnable.

- Jeu 1440p « compétitif », peu d’apps en arrière‑plan : 32 Go restent viables, même autour d’une 4090 ti, à condition de garder Windows propre et le navigateur sage.

- Jeu 4K + RT élevé, streaming d’assets soutenu : visez 48 Go pour respirer et lisser les 1 % lows, surtout sur des cartes au niveau d’une 4090 ti.

- Simulation lourde (MSFS, sim auto), mondes ouverts moddés : 64 Go pour amortir les pics, limiter le swap et stabiliser les chargements.

- Création 3D/vidéo 4K, multitâche poussé : 64 Go comme socle, 96 Go si vous cumulez montage, rendu et navigateur vorace.

- IA locale, grands modèles, scènes 8K expérimentales : 96 Go à 128 Go selon pipelines, mais validez vos besoins réels avant d’investir.

Les kits 48 Go (2×24) en DDR5 sont une excellente passerelle : souvent dual‑rank, ils offrent un petit bonus de bande passante effective tout en restant plus simples à stabiliser que 4 barrettes. Sur Intel, 64‑72 Gb/s réels suffisent déjà à tenir haut le framerate.

Précision sur 48 Go et 96 Go

48 Go calibrent bien une machine jeu‑créatif polyvalente : compiling rapide, navigation lourde et jeu AAA stable. 96 Go servent aux workflows qui montent et démontent d’énormes scènes. Sur une 4090 ti, ces marges se traduisent par moins de pics de latence en pleine action.

J’insiste : la quantité atténue les pointes, pas la qualité du code. Un titre mal optimisé tricotera quand même. Mais avec une 4090 ti, vous évitez au moins de cumuler les handicaps. Un système respirant pardonne davantage les caprices logiciels.

4090 ti : tests réels, micro-saccades et frame pacing

J’ai conservé un carnet de benchs maison sur trois jeux « méchants » et deux applis pro. Même machine, même drivers, seul la RAM changeait : 32, 48 puis 64 Go. L’objectif n’était pas de battre des records, mais d’observer le confort avec une 4090 ti.

Ma méthode de test

J’utilise des parcours répétables, je logge les temps de frame et les 1 %/0,1 % lows, et je surveille l’usage RAM/VRAM. Je laisse tourner Discord, un navigateur et un éditeur de notes, parce que c’est la vraie vie, surtout quand on exploite une 4090 ti.

- Cyberpunk 2077 PT en 4K : 32 Go ok mais stutters lors des trajets rapides. 48 Go lisse nettement le streaming. 64 Go suppriment presque tous les hoquets.

- MSFS 2024 au‑dessus de grandes villes : 48 Go réduisent les pauses texture. 64 Go gardent les pics en dessous de 25 ms, bien plus confortable au manche.

- Cities: Skylines II très chargé : 32 Go saturent parfois. 48 Go sont « vivables ». 64 Go donnent une simulation qui avance sans soupirs audibles.

- Unreal Editor avec Nanite/Lumen : 64 Go suppriment les compilations de shaders à rallonge en changeant fréquemment de map.

- Premiere Pro, timeline 4K H.265 + LUT : 48 Go fluidifient la scrubbar. 64 Go évitent les gels au moment d’exporter parallèlement.

Règle d’or : si votre framerate moyen grimpe mais que vous « sentez » toujours des hoquets, ce n’est pas le GPU qui manque d’air, c’est souvent la RAM qui manque d’aisance.

Avec 64 Go, j’ai surtout vu les 1 % lows remonter, donc moins de à‑coups. La moyenne bouge peu, mais le confort explose. C’est exactement ce qu’on veut quand on a une 4090 ti : de la puissance, certes, mais livrée avec constance.

Comment choisir et configurer sa RAM pour 4090 ti

La DDR5 change la donne : mieux vaut un kit stable à 6000‑6400 MT/s avec timings corrects qu’une fusée à 7600 instable. Sur une 4090 ti, l’important est d’éviter le swap furtif et de garder le contrôleur mémoire zen, pas de gagner 2 fps synthétiques.

Préférez 2 barrettes à 4 pour atteindre aisément la fréquence visée. Les modules 2×24 Go sont souvent dual‑rank et donnent de beaux résultats. Les 2×32 Go restent excellents si vous avez besoin d’une marge durable sur les jeux et les projets créatifs.

- Activez XMP/EXPO dans l’UEFI, puis vérifiez la stabilité avec MemTest et OCCT pendant au moins une heure.

- Sur AMD, 6000 MT/s est souvent le « sweet spot ». Sur Intel, 6400‑7200 MT/s fonctionnent bien, selon la qualité du kit et du contrôleur.

- Évitez de mélanger des kits : mêmes puces, mêmes révisions. La stabilité prime, surtout si vous streamez et capturez pendant le jeu.

- Gardez une marge thermique : boîtier ventilé, profils de ventilation cohérents, et laissez de l’air autour du radiateur RAM.

Stabilité d’abord

Mon approche est simple : je sacrifie 2‑3 % de bande passante pour une stabilité à toute épreuve. Sur une 4090 ti, je préfère des timings un peu plus laxes mais aucun crash au milieu d’un raid, d’un rendu ou d’un enregistrement.

Enfin, mesurez votre usage réel. Regardez l’occupation mémoire après une heure de jeu, un montage, ou une compilation. Les chiffres parlent : si vous frôlez 30 Go en routine, 48 Go vous iront comme un gant. À 42‑45 Go, passez à 64 Go.

Tableau récapitulatif et scénarios réels pour 4090 ti

Voici un aperçu qui aide à visualiser le rapport besoin/marge. Il ne remplace pas vos tests, mais cadre la réflexion. Pour une 4090 ti, l’objectif est de minimiser les pointes et de garder des réserves pendant les charges mixtes.

| Capacité RAM | Jeux 1440p/4K | Création 4K/8K | Simulation / IA locale | Notes |

|---|---|---|---|---|

| 32 Go | OK, 4K exigeant limite le confort | Projets 4K légers | Basique | Surveillez le swap, fermez les apps parasites |

| 48 Go | Très bon, 1 % lows en hausse | 4K soutenu, 8K en proxy | Expérimentations crédibles | Excellent ratio performance/prix en DDR5 |

| 64 Go | Idéal pour RT + textures lourdes | 4K multicouche, 8K occasionnel | Simulations étendues | Réduit nettement les microsaccades |

| 96 Go | Sur‑spéc pour le jeu seul | 8K complexe, VFX, gros caches | IA locale plus ambitieuse | À réserver aux workflows lourds |

| 128 Go | Utile si mods extrêmes | 8K multicouche, rendu simultané | Entraînement local de modèles | Contrôlez la stabilité à froid/chaud |

En résumé, 48 Go pour le joueur‑créatif pressé, 64 Go pour la tranquillité tous terrains. Au‑delà, on cible des cas spéciaux. Avec une 4090 ti, ce dimensionnement privilégie la constance plutôt que le score maximal ponctuel.

Optimiser le système pour une 4090 ti

Avant toute chose, gardez en tête qu’une 4090 ti ne compense pas un système mal calibré. La RAM est le lien entre stockage, CPU et GPU ; négliger cet élément provoque des ruptures de flux ressenties comme des micro‑saccades.

Pensez à la RAM comme à un tampon de préparation : plus elle est capable de stocker d’assets décompressés, moins le SSD aura à se réveiller. C’est la première source de latence perceptible lors d’une session de jeu ou d’un rendu.

Surveillez aussi l’ordre des slots, la fréquence appliquée, et la version du BIOS. Un kit nominal 6400 MT/s mal installé peut devenir moins performant que 6000 MT/s correctement configuré, surtout avec une 4090 ti.

- Mettez à jour l’UEFI avant d’activer XMP/EXPO.

- Installez les barrettes dans les slots recommandés par la carte mère.

- Testez la stabilité avant d’imputer un stutter à la carte graphique.

Checklist d’achats et compatibilité pour 4090 ti

Choisir de la RAM n’est pas seulement une question de capacité. Regardez la compatibilité des profils, la tension recommandée, et la qualité des puces. Un kit mal assorti peut provoquer des freezes rares et difficiles à diagnostiquer.

Si vous achetez pour une 4090 ti, optez pour des modules éprouvés par la communauté, préférez des kits testés à haute fréquence et évitez les mélanges hétérogènes qui fatiguent le contrôleur mémoire.

| Kit | Format | Usage conseillé |

|---|---|---|

| 2×24 Go 6000 MT/s | Dual‑rank | Bon équilibre jeu/création avec 4090 ti |

| 2×32 Go 6400 MT/s | Dual/Single selon modèle | Idéal pour multitâche et 4K |

| 4×16 Go 7600 MT/s | Quad possible | Hautes fréquences, risque d’instabilité |

Tests rapides à lancer chez soi pour valider une 4090 ti

Avant d’aller plus loin, voici trois tests simples qui dévoilent les problèmes de RAM les plus courants. Ils prennent peu de temps et donnent une idée fiable de la marge disponible sans logiciels complexes.

Protocoles efficaces

1) Lancez un parcours constant dans un jeu open world en 4K, surveillez les 0,1 % lows et l’usage RAM. 2) Ouvrez Premiere avec une timeline 4K et scrubbing intensif. 3) Exécutez MemTest pendant qu’un benchmark tourne.

Ces tests révèlent si la machine swap, si la VRAM pousse la RAM ou si le contrôleur mémoire flanche. Avec une 4090 ti, ce trio suffit souvent à trancher entre manque de RAM et bug logiciel.

Risques, erreurs courantes et mythes autour de la 4090 ti

Il existe des idées reçues qu’il faut balayer. Non, la fréquence extrême n’est pas la panacée pour gommer les micro‑hoquets. Oui, la capacité prime souvent sur la latence pour les charges mixtes. Ces nuances sont essentielles avec une 4090 ti.

Une erreur fréquente est d’assembler quatre barrettes différentes pour « atteindre » 128 Go. Résultat : instabilité intermittente, profils inconstants et diagnostics interminables. Privilégiez des kits identiques pour éviter ce marécage.

Autre piège : sous‑estimer le navigateur. Ouvrir vingt onglets peut consommer plusieurs gigaoctets en quelques minutes. Avec une 4090 ti dans la tour, fermez les processus non essentiels lors des tests pour obtenir des mesures propres et comparables.

- Ne basez pas votre décision sur un seul benchmark.

- Mesurez en conditions réelles, avec vos outils et vos mods habituels.

- Considérez le fichier d’échange comme dernier recours, pas comme tampon normal.

Bilan pratique et conseils de terrain pour la 4090 ti

Pour résumer en actes : si vous jouez en 4K avec RT et mods, visez 48 Go au minimum. Si votre workflow mélange rendu et navigation lourde, 64 Go devient une assurance confort, particulièrement avec une 4090 ti.

Lors d’un montage prolongé ou d’une simulation, surveillez la RAM après une heure d’utilisation. Si l’occupation approche de la capacité totale, augmentez. Prévoir 15‑20 % de marge évite la sensation désagréable de « manquer d’air » lors d’un pic.

Enfin, documentez vos tests et conservez des profils stables dans l’UEFI. La mémoire n’est pas un composant jetable : investir un peu de temps à l’installer correctement paie chaque jour d’utilisation d’une 4090 ti.

Matériel complémentaire et bonnes pratiques

N’oubliez pas l’alimentation, le refroidissement et la ventilation du boîtier. Une carte graphique puissante comme la 4090 ti augmente les besoins en airflow, et une RAM chaude perd en stabilité si l’environnement est mauvais.

Un SSD rapide réduit la pénalité du swap mais ne l’élimine pas. Si votre système s’appuie trop sur le fichier d’échange, les hoquets persistent. La vraie solution reste d’augmenter la RAM plutôt que de compter sur un NVMe plus véloce.

Je recommande aussi d’automatiser la collecte des logs pendant vos sessions de jeu ou de rendu. Un simple script qui enregistre l’usage RAM/VRAM par intervalle aide à détecter les tendances et à justifier un upgrade.

Petite astuce de « bricoleur »

Si vous hésitez entre 48 et 64 Go, testez avec une barrette supplémentaire empruntée ou vendue à bas prix, puis reproduisez vos scénarios. Ce troc temporaire vous évite une dépense définitive et fournit des données concrètes.

Faut‑il toujours activer XMP/EXPO pour tirer parti d’une 4090 ti ?

Oui, activer XMP/EXPO permet d’exploiter la fréquence annoncée du kit. Cependant, validez toujours la stabilité après activation. Un profil qui plante n’aide personne, surtout pas votre 4090 ti.

La fréquence RAM améliore‑t‑elle le framerate sur 4090 ti ?

La fréquence peut offrir des gains modestes, surtout sur CPU‑bound. Sur des scénarios GPU‑bound avec une 4090 ti, l’impact est souvent négligeable comparé à l’augmentation de capacité.

Est‑ce utile de mélanger des kits pour obtenir plus de RAM ?

Mélanger des kits n’est rarement recommandé. Les différences de latence et de rang peuvent provoquer des instabilités subtiles, difficiles à corriger. Préférez un seul kit homogène pour une expérience fiable avec une 4090 ti.

Combien de RAM pour le streaming en 4K avec une 4090 ti ?

Pour streamer en 4K tout en jouant, 64 Go est une valeur sûre si vous exécutez en parallèle encodeur logiciel, navigateur et outils de capture. 48 Go peuvent suffire, mais surveillez les 1 % lows en jeu.

La RAM affecte‑t‑elle la latence d’input avec une 4090 ti ?

Indirectement, oui. Les pauses causées par le swap ou la saturation de cache peuvent générer des micro‑latences perceptibles. Une RAM suffisante maintient le frame pacing et améliore la réactivité perçue.

À quel moment passer de 64 à 96 Go avec une 4090 ti ?

Si vos workflows montrent régulièrement une occupation mémoire proche de 70‑80 % avec rendu ou IA locale, envisagez 96 Go. Sinon, l’upgrade reste un luxe plutôt qu’une nécessité pour la majorité des joueurs.

Pour conclure, la RAM n’est pas un simple chiffre à cocher mais un élément de confort. Avec une 4090 ti, privilégiez la constance, testez dans vos conditions réelles et choisissez une marge qui vous évite des surprises en pleine session. L’investissement intelligent en RAM change profondément l’expérience, et ça se sent.

Ordinateur

Lossless scaling minecraft : guide complet pour booster FPS et qualité d’image sur PC

J’ai longtemps cherché un moyen simple d’augmenter mes images par seconde sans massacrer la netteté. Un soir, après avoir jonglé avec des options graphiques pendant une heure, j’ai lancé Lossless Scaling depuis Steam et j’ai retrouvé de la fluidité sans renoncer aux détails.

Ce petit utilitaire ajoute deux briques majeures à votre boîte à outils PC : un upscaling spatial très propre et une génération d’images qui lisse le mouvement. Résultat, les jeux paraissent plus nets en haute résolution et la sensation de fluidité grimpe, même quand le GPU tire la langue.

Sur un écran 4K branché à un portable milieu de gamme, j’ai gagné une marge confortable en lançant le jeu en 1440p puis en laissant l’outil faire le reste. Avec lossless scaling minecraft, l’effet est particulièrement parlant quand on active des shaders ou des packs de textures lourds.

Dans ce guide, je vous montre comment l’utiliser avec méthode, quels réglages adopter selon votre écran, et où se situent les limites. L’idée n’est pas de vendre du rêve, mais d’expliquer précisément ce qui marche et ce qui ne marche pas.

Qu’est-ce que lossless scaling minecraft et comment ça marche

Lossless Scaling est une application Steam qui s’accroche à la fenêtre du jeu pour la redimensionner et l’améliorer en temps réel. Elle ne remplace pas vos options graphiques, elle s’y superpose pour en tirer un gain de FPS et de netteté.

Contrairement à DLSS, FSR ou XeSS, il ne faut pas que le jeu l’intègre. Vous lancez le titre en fenêtré sans bordure, vous déclenchez l’outil, et l’image est agrandie proprement vers la cible d’écran, quel que soit le moteur du jeu.

Pour l’upscaling spatial, plusieurs méthodes coexistent, des filtres rapides aux approches plus coûteuses mais plus fines. Côté mouvement, la brique LSFG (Lossless Scaling Frame Generation) insère des images intermédiaires afin d’augmenter la cadence perçue.

L’application sait aussi appliquer un sharpening mesuré pour regagner de la micro-détail après agrandissement. Quand c’est bien dosé, l’image garde un contour propre sans halos ni bords crénelés trop visibles sur les textures haut contraste.

Sur des titres plus anciens, ou mal optimisés, l’effet peut être spectaculaire. J’ai revu un vieux RPG grimper de 40 à 70 FPS en 4K simulée, alors que la machine plafonnait en rendu natif. Avec lossless scaling minecraft, on retrouve le même bénéfice pratique.

Upscaling spatial vs génération d’images

L’upscaling spatial consiste à rendre le jeu en plus faible résolution, puis à rééchantillonner chaque trame vers l’écran. C’est immédiat, déterministe et fiable, avec une latence quasi inchangée et des gains de performance prévisibles selon l’échelle choisie.

La génération d’images crée des images supplémentaires entre deux trames réelles. Cela augmente la fluidité perçue, mais n’améliore pas le temps de réponse à l’entrée. Sur des jeux calmes ou cinématographiques, c’est bluffant ; en compétitif, c’est à doser.

Pourquoi l’utiliser sur un PC de jeu moderne

Les dalles 1440p et 4K se sont généralisées, mais toutes les cartes ne tiennent pas 120 ou 144 Hz en natif. Passer par un agrandissement bien fait permet de préserver la stabilité des FPS, donc une sensation de contrôle plus constante.

Sur un écran VRR (G-Sync ou FreeSync), viser une plage confortable avec un rendu interne plus léger évite les chutes brutales. Au lieu d’osciller autour d’un seuil instable, on verrouille une fenêtre fluide et lisse, sans micro-saccades pénibles.

Dans les jeux bac à sable, les mods et les shaders font vite exploser la charge GPU. C’est là que lossless scaling minecraft brille : vous choisissez une résolution interne raisonnable, l’outil s’occupe du reste et la sensation reste propre sur grand écran.

Les portables avec GPU milieu de gamme profitent énormément de ce genre d’approche. Rendre en 1080p et agrandir vers 1440p ou 4K via l’outil est souvent meilleur que cocher toutes les options lourdes qui plombent les 1 % lows.

Quand je présente Lossless Scaling à des amis, je résume ainsi : gardez ce que vos yeux perçoivent, retirez ce que votre GPU ne voit pas. Le compromis est pragmatique, surtout sur les écrans ultradéfinis.

Autre cas utile : les jeux mal optimisés au lancement. On gagne du temps et de la tranquillité en forçant un pipeline simple et reproductible, le temps que les correctifs arrivent. J’ai ainsi rendu jouable un AAA boudé par mon processeur.

- Préserver la lisibilité des textures en résolution élevée tout en allégeant le rendu interne

- Sécuriser une cadence stable pour la souris et les sensations au pad

- Réduire l’aliasing perçu avec un sharpening calibré

- Contourner l’absence d’upscaling intégré dans les vieux moteurs

Mon retour terrain

Sur un écran 4K 60 Hz, un rendu interne 1440p avec agrandissement m’a donné un net confort, y compris dans les scènes nocturnes. Les textes sont restés lisibles et l’aliasing n’a pas rejailli tant que le renforcement restait modéré.

Sur un 1440p 144 Hz, viser 90 à 100 FPS réels puis activer la génération d’images pour lisser vers 160 donne une sensation d’animation plus riche. Le délai d’entrée ne bouge pas, mais l’œil apprécie réellement la continuité du mouvement.

Installer et configurer lossless scaling minecraft via Steam

L’application s’installe depuis la boutique Steam comme n’importe quel jeu. Elle est légère, se met à jour rapidement et n’ajoute pas de service résident inutile. Après l’installation, on la lance en arrière-plan et on bascule en jeu.

- Dans Steam, installez Lossless Scaling, puis ouvrez-le. Prenez le temps de parcourir les onglets pour repérer les options d’upscaling, de sharpening et de génération d’images disponibles, ainsi que les raccourcis clavier associés.

- Réglez votre jeu en fenêtré sans bordure, avec la résolution interne visée. Visez une charge GPU raisonnable afin de stabiliser la fréquence d’images avant d’activer l’agrandissement temps réel depuis l’application.

- Dans l’outil, choisissez la méthode d’upscaling adaptée à votre échelle. Pour 1080p vers 1440p, un filtre de qualité intermédiaire suffit souvent ; pour 1440p vers 4K, préférez une méthode plus fine et un sharpening prudent.

- Activez le sharpening avec parcimonie. Commencez bas, autour de 0,2 à 0,3, puis ajustez en observant les contours des éléments à fort contraste, comme les textes clairs sur fond sombre ou les motifs répétitifs.

- Pour la fluidité, testez la génération d’images. Lancez une scène de caméra libre et regardez les panoramiques rapides. Si vous voyez du ghosting marqué sur les éléments fins, diminuez la netteté ou désactivez la génération.

- Assignez un raccourci pour activer ou désactiver l’agrandissement en un clic. Très utile pour comparer à la volée sans retourner dans les menus ni casser votre session de jeu pendant des tests répétés.

- Si vous disposez d’un écran VRR, laissez la synchronisation verticale désactivée côté jeu. Le VRR fera le liant entre la cadence réelle et la cadence perçue, tout en minimisant les micro-déchirures résiduelles.

- Gardez un œil sur l’utilisation GPU et la température. Si le GPU sature, réduisez légèrement la résolution interne. Le but est de stabiliser les 1 % lows autant que la moyenne, pour une sensation réellement homogène.

Dans certains titres, l’exclusif plein écran gêne l’accroche de l’outil. Passez alors en fenêtré sans bordure. Si un anti-cheat bloque les overlays, lancez d’abord le jeu, puis l’application, ou inversement, selon le comportement observé.

La première heure, testez méthodiquement : changez l’échelle, ajustez la netteté, déclenchez ou coupez la génération d’images, et concentrez-vous sur vos sensations. Avec lossless scaling minecraft, je conseille de valider d’abord la lisibilité des blocs à distance.

Quand tout est en place, vous avez un profil reproductible, facile à réactiver sur les prochaines sessions. Un simple raccourci permet de comparer, histoire de vérifier que l’upscaling vous apporte plus qu’il ne retire visuellement.

Réglages conseillés pour lossless scaling minecraft selon votre écran

Il n’existe pas de réglage magique valable partout. L’idéal dépend de la dalle, de la distance d’observation et de la plage de fréquence visée. Voici des combinaisons testées qui fonctionnent bien dans la majorité des cas rencontrés.

| Écran / objectif | Résolution du jeu | Méthode | Netteté conseillée | LSFG | Commentaire |

|---|---|---|---|---|---|

| 4K 60 Hz, visée 60 stables | 2560×1440 | Qualité élevée | 0,25 à 0,35 | Off | Image propre, contours doux, coût GPU réduit sans halos marqués sur les textes fins |

| 4K 120 Hz, visée 90+ | 2560×1440 | Qualité élevée | 0,2 à 0,3 | On | Génération efficace pour lisser le mouvement, surveiller le ghosting sur éléments rapides |

| 1440p 144 Hz, visée 120 | 1920×1080 | Intermédiaire | 0,3 à 0,4 | On | Bon compromis netteté/charge, très agréable en panoramiques horizontaux |

| 1080p 60 Hz, PC modeste | 1600×900 | Rapide | 0,35 à 0,45 | Off | Gains immédiats sur GPU ancien, attention aux micro-détails sur textures denses |

| Ultrawide 3440×1440, visée 100 | 2560×1080 | Qualité élevée | 0,25 à 0,35 | On | Bien lisser les bords inclinés, vérifier la lisibilité de l’interface aux coins |

Pour le sharpening, privilégiez la progression lente. Un cran trop haut, et les arêtes deviennent sur-accentuées, surtout sur les écritures. Un cran trop bas, et l’agrandissement paraît légèrement cotonneux, notamment sur les textures à motifs fins.

Dans la pratique, lossless scaling minecraft fonctionne bien avec une résolution interne une marche en dessous de votre écran, puis un agrandissement soigné. Si l’outil génère des halos, baissez la netteté d’un dixième et validez à l’œil à moyenne distance.

Limites, artefacts et bonnes pratiques avec lossless scaling minecraft

Aucune solution n’est magique. La génération d’images peut créer du ghosting sur les éléments à déplacement rapide, ou lisser un mouvement de manière un peu trop « vidéo ». Selon votre sensibilité, ce compromis sera acceptable ou non.

Sur les jeux compétitifs, évitez de viser une cadence perçue trop élevée si la cadence réelle reste modeste. La latence d’entrée ne baisse pas. Mieux vaut un 90 propre et réactif qu’un 140 perçu avec une base chancelante et des 1 % lows faibles.

Certains filtres d’upscaling aiment les géométries régulières, d’autres moins. Une grille très fine peut « chatouiller » le filtre et produire un scintillement discret. Baissez la netteté, ou changez de méthode si ce motif vous dérange visuellement.

Côté compatibilité, les overlays se partagent parfois mal la fenêtre. Si vous cumulez enregistreur, compteur d’images et outil d’agrandissement, désactivez les éléments non essentiels. L’idée est de réduire les conflits et de préserver la stabilité.

- Utilisez le mode fenêtré sans bordure pour maximiser la compatibilité générale des overlays

- Testez les panoramiques rapides pour évaluer les artefacts de génération d’images

- Surveillez les 1 % lows plutôt que la moyenne brute des FPS

- Gardez un raccourci pour basculer à la volée et comparer l’impact réel

Quand éviter Lossless Scaling

Si votre machine atteint déjà votre fréquence cible en natif, l’outil apportera peu et pourrait même ajouter une étape inutile. Dans ce cas, gardez-le comme filet de sécurité pour les jeux plus lourds et les situations spécifiques.

Dans un environnement fortement compétitif, privilégiez la réactivité brute à la fluidité perçue. Désactivez la génération et gardez un agrandissement léger, ou restez en natif si votre carte vidéo tient la cadence souhaitée sans fléchir.

Pour finir sur une note pragmatique, lossless scaling minecraft ne remplace pas une optimisation de paramètres bien pensée. C’est une couche complémentaire, à activer quand elle vous rend un service concret à l’écran, pas par principe.

Astuces avancées pour lossless scaling minecraft

Commencez par identifier les scènes les plus lourdes de votre jeu et testez plusieurs résolutions internes en session courte. Le but est d’obtenir une marge GPU confortable tout en conservant la lisibilité à distance.

Utilisez un profil dédié par titre : textures, shaders et post-traitements ne pèsent pas de la même façon selon le moteur. Sauvegardez vos réglages dans l’application pour basculer rapidement entre profils.

Surveillez les 1 % lows plutôt que la moyenne. Une petite baisse ponctuelle ruine l’impression de fluidité ; stabiliser ces valeurs est souvent plus efficace qu’augmenter la moyenne brute des FPS.

Ajuster la latence perçue sans la sacrifier

Si vous combinez génération d’images et agrandissement, testez la réactivité en jeu réel, pas seulement en vidéo. Placez un repère visuel et comparez la réactivité entre natif et agrandi, en conservant vos sensations.

Diminuez légèrement la génération si vous observez du ghosting sur les objets fins. Parfois, éliminer une image intermédiaire suffit à rendre le résultat plus propre et plus crédible pour votre œil.

Quand la latence importe, désactivez LSFG et compensez par un rendu interne légèrement plus élevé. Vous privilégierez alors la réactivité tout en gardant une charge GPU raisonnable, une stratégie utile en multijoueur.

Profils recommandés pour lossless scaling minecraft

Voici des configurations concrètes à appliquer selon votre matériel. Ces profils sont pensés pour obtenir un bon rapport qualité/perf sans réglages excessivement échafaudés.

| Matériel | Résolution cible | Résolution interne | Méthode | Netteté |

|---|---|---|---|---|

| GPU entrée de gamme | 1080p | 1280×720 | Rapide | 0,35 |

| GPU milieu de gamme | 1440p | 1920×1080 | Intermédiaire | 0,30 |

| GPU haut de gamme | 4K | 2560×1440 | Qualité élevée | 0,25 |

| Portable équilibré | 1440p | 1600×900 | Intermédiaire | 0,32 |

Adaptez la netteté selon le rendu du jeu : effets de bloom, fumées et particules altèrent la perception et demandent souvent moins de renforcement pour éviter les halos.

Pour les écrans ultrawide, testez la lisibilité des interfaces en coin. Une résolution interne trop basse dégrade rapidement les HUD, même si le centre de l’image reste propre.

Dépannage et compatibilité lossless scaling minecraft

Si l’outil ne capture pas l’écran, vérifiez d’abord le mode plein écran. Passez en fenêtré sans bordure et désactivez les overlays concurrents. Le fonctionnement dépend souvent de l’ordre de lancement des programmes.

En cas d’artefacts visuels, essayez un autre filtre d’upscaling et réduisez la netteté. Certains jeux exposent des textures atypiques qui piègent les algorithmes les plus fins, une alternative plus simple marche souvent mieux.

Si un anti-cheat bloque l’accès, consultez la documentation du jeu. Parfois il suffit de lancer Lossless Scaling avant le jeu, ou l’inverse, pour contourner le blocage sans compromettre la sécurité.

- Testez les raccourcis et scripts de lancement si l’ordre d’exécution pose problème

- Désactivez temporairement les enregistreurs vidéo pour isoler le conflit

- Revenez à une configuration standard si un correctif du jeu modifie le renderer

Pour les utilisateurs de multi-GPU, l’application peut suivre le GPU principal seulement. Assurez-vous que la carte utilisée pour le rendu est bien la carte par défaut dans Windows et dans les paramètres du jeu.

Cas d’usage et retours pratiques

J’ai testé l’outil sur plusieurs titres : des simulations lentes, des RPG narratifs et des FPS plus rapides. Chaque catégorie demande une approche différente, notamment pour la génération d’images.

Sur un RPG à caméra libre, la génération apporte une fluidité cinématique très agréable. En revanche, sur un FPS nerveux, je privilégie une résolution interne plus élevée et LSFG désactivé pour préserver la précision.

Avec des mods graphiques lourds, l’outil m’a permis de garder une résolution affichée élevée sans sacrifier les performances. Les textures détaillées restent lisibles, et le sharpening compense l’adoucissement lié à l’agrandissement.

Pour ceux qui streament, testez la configuration en local avant diffusion. L’encodeur logiciel peut se retrouver en concurrence avec la charge GPU, une répartition équilibrée évite les baisses de qualité en live.

Mes raccourcis et routines de tests

J’utilise trois profils rapides : HauteQualité, Équilibré et Performances. Chacun change la résolution interne, la méthode d’upscaling et le niveau de sharp. Cela me permet d’adapter la session en quelques secondes selon la carte et le jeu.

Avant une session longue, je lance un enchaînement de scènes de test : intérieur chargé, panorama et combat. Ces séquences révèlent les faiblesses du profil et permettent des ajustements ciblés, plus fiables que des essais aléatoires.

Conserver une checklist me sauve du temps : vérifier VRR, désactiver V-Sync, activer fenêtré sans bordure et paramétrer le raccourci d’activation. Ces petites habitudes rendent l’expérience reproductible d’un jour à l’autre.

Votre prochain pas avec Lossless Scaling

Si vous n’avez essayé que superficiellement, faites un test dédié d’une heure sur un titre lourd. Documentez vos sensations et mesurez les 1 % lows. La différence entre un réglage confortable et un réglage extrême est souvent subtile mais cruciale.

Partagez vos profils autour de vous. Les communautés de joueurs et les forums regorgent d’exemples concrets qui accélèrent la mise au point, surtout pour des moteurs de jeu particuliers ou des résolutions atypiques.

Enfin, gardez l’esprit critique : l’outil est un catalyseur, pas une solution miracle. Si une option casse l’immersion, revenez en arrière. L’important est l’expérience ressentie, pas les chiffres sur un compteur.

Foire aux questions

1) Lossless Scaling fonctionne-t-il avec tous les jeux ?

La plupart des jeux fonctionnent en fenêtré sans bordure, mais l’accès peut être bloqué par certains anti-cheat. Testez en lançant l’outil avant ou après le jeu et consultez les ressources officielles en cas de blocage.

2) Est-ce que la génération d’images augmente la latence ?

Non, elle n’améliore pas la latence d’entrée. La génération augmente la fluidité perçue sans réduire le temps de réaction. En compétitif, privilégiez la réactivité native plutôt que l’effet de fluidité seul.

3) Quelle différence entre Lossless Scaling et DLSS/FSR ?

DLSS/FSR sont intégrés au moteur et optimisés pour des jeux spécifiques. Lossless Scaling agit en surcouche indépendante, utile quand aucun upscaler natif n’est disponible ou pour uniformiser le rendu entre plusieurs titres.

4) Mon écran supporte VRR, dois-je l’utiliser avec l’outil ?

Oui, le VRR est complémentaire. Il permet d’atténuer les variations de fréquence et rend l’agrandissement plus fluide. Veillez cependant à désactiver la V-Sync dans le jeu pour éviter les conflits.

5) Quels réglages pour éviter le ghosting ?

Réduisez la force de génération d’images, diminuez le sharpening et testez une méthode d’upscaling différente. Les paramètres varient selon les scènes rapides ou statiques ; privilégiez l’observation à l’aveugle.

6) Le sharpening peut-il abîmer les textures ?

Un sharpening excessif crée des halos et rend les textures artificielles. Progressez par petits pas, observez à distance normale et évitez les réglages extrêmes sur les éléments fins comme les écritures et motifs répétitifs.

Et maintenant, à vous de jouer

Installez l’application, définissez un profil simple et testez pendant une heure. Notez ce qui vous gêne visuellement et ajustez. Avec un peu de méthode, lossless scaling minecraft devient un outil fiable pour améliorer votre confort de jeu.

Le plus important : considérez l’outil comme un partenaire de réglage, pas comme une solution universelle. Testez, comparez et conservez ce qui fonctionne pour vos yeux et votre matériel.

-

Logiciels / Applications6 mois ago

Logiciels / Applications6 mois agoGestionnaire des taches : toutes les méthodes pour l’ouvrir, même quand Windows bloque

-

Logiciels / Applications12 mois ago

Logiciels / Applications12 mois agoPlaylists à télécharger gratuitement : le guide ultime pour écouter sans payer

-

Ordinateur2 ans ago

Ordinateur2 ans agoordinateurs et télétravail : quel modèle choisir pour être productif ?

-

Logiciels / Applications11 mois ago

Logiciels / Applications11 mois agoTop 15 des applications mobiles incontournables en 2025 : notre sélection honnête et utile

-

Smartphone11 mois ago

Smartphone11 mois agoTéléphone cassé : comment récupérer vos données

-

Smartphone12 mois ago

Smartphone12 mois agoComment récupérer des photos supprimées sur iPhone : le guide complet

-

Smartphone5 mois ago

Smartphone5 mois agoMon clavier ne fonctionne plus : solutions testées et approuvées

-

Smartphone6 mois ago

Smartphone6 mois agoSony a6000 : test, avis, prix et bons plans en continu